CAUC: Combining Channel Attention U-Net and Convolution for Seismic Data Resolution Improvement

原创2024/7/12约 888 字大约 4 分钟

CAUC: Combining Channel Attention U-Net and Convolution for Seismic Data Resolution Improvement

地震分析和解释对数据分辨率很敏感。由于复杂的自然环境和有限的采集技术,原始地震数据分辨率通常较低。但地震子波的频率带宽是可调的,所以根据这些特征来提高数据的分辨率是可行的。本文提出了一种通道注意U-Net和物理卷积组合(CAUC)算法来增强地震数据的分辨率。

方法

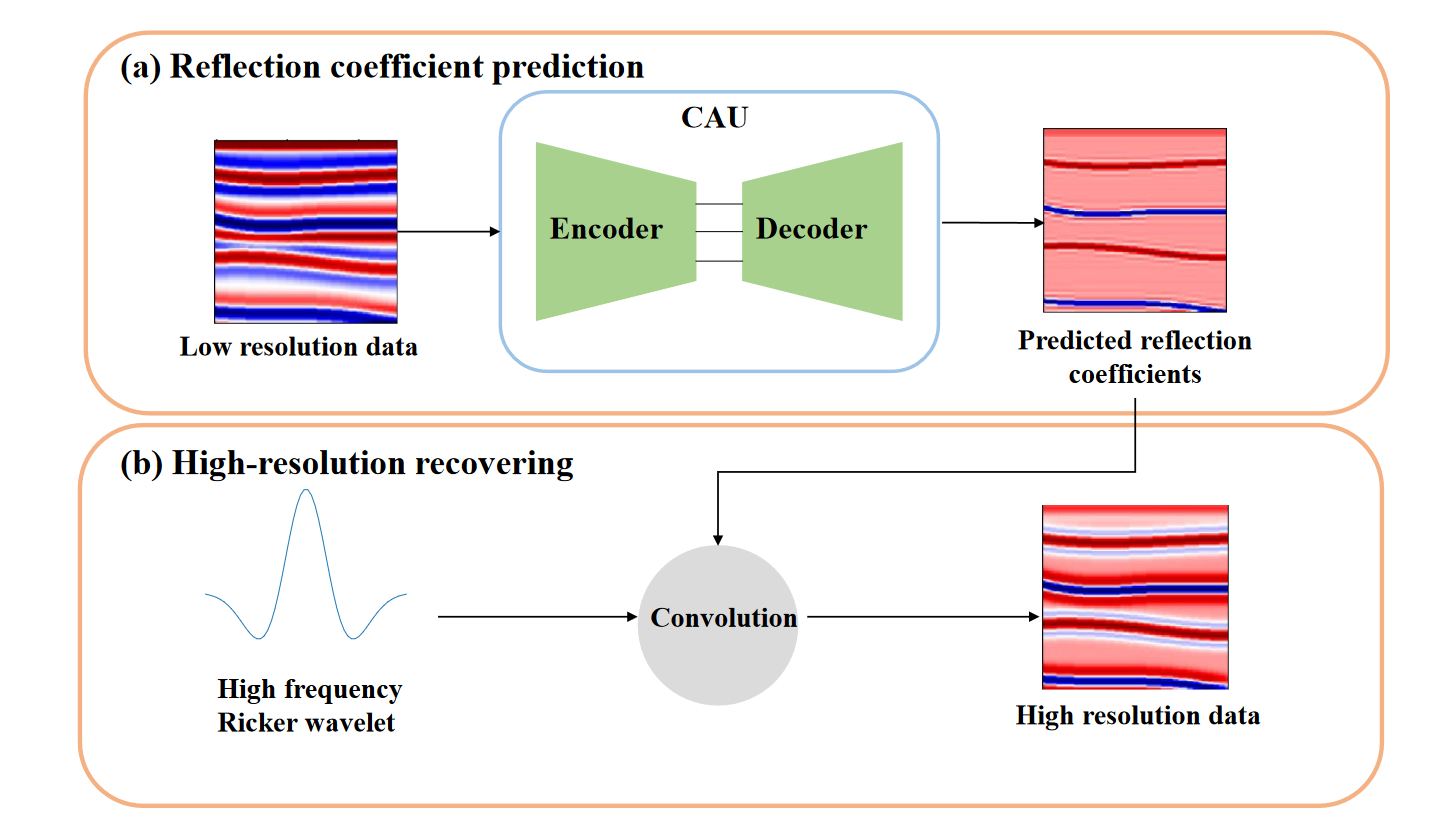

算法框架

- 可以看到网络核心是利用CAU的编码器-解码器架构进行反射系数反演,随后使用更高频的雷克子波和反射系数进行物理卷积运算得到地震数据。

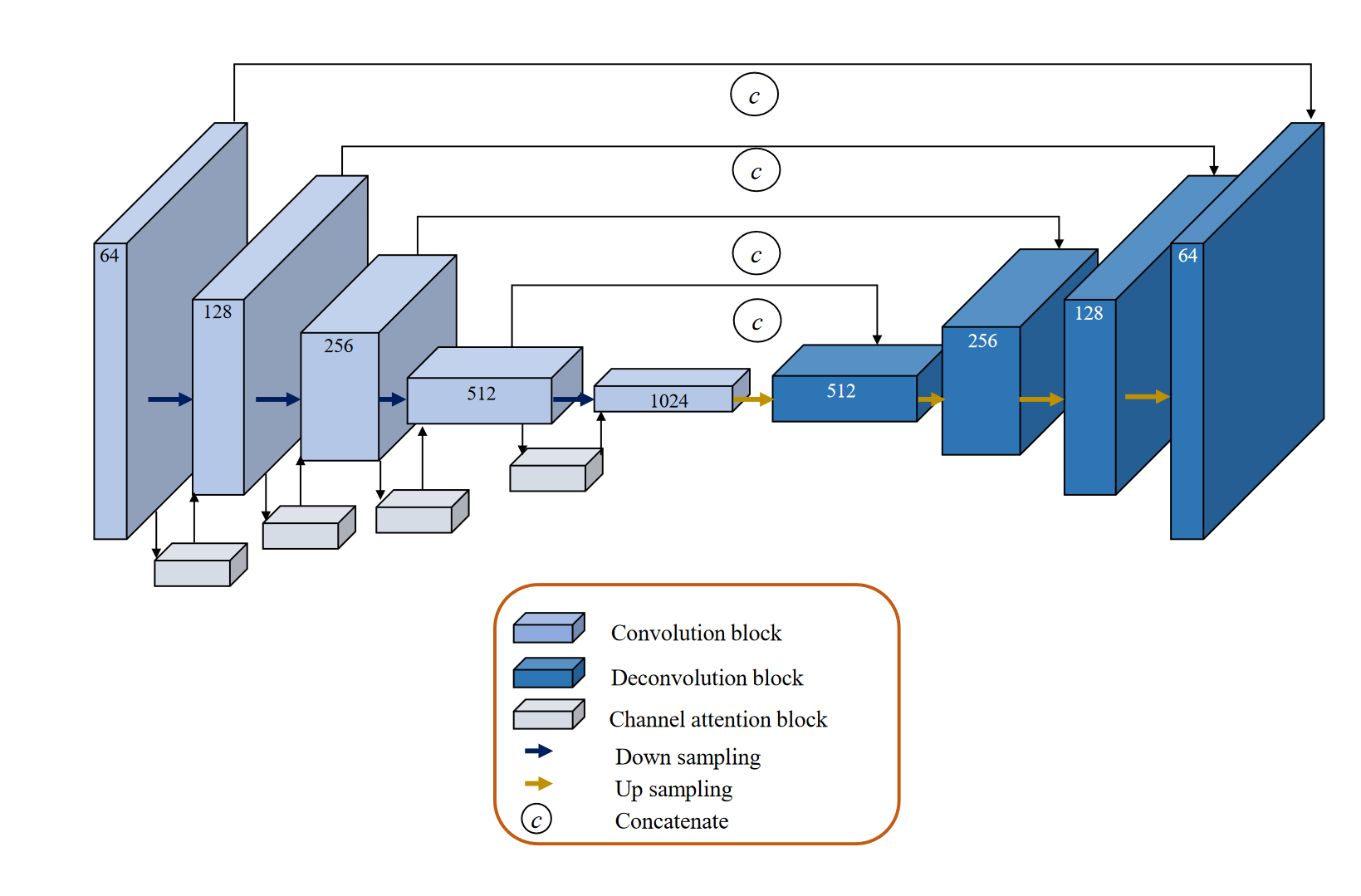

通道注意U-Net

通道注意U-Net具体架构,可以看到整个大架构还是U-Net,利用跳跃连接的优势优化网络。在编码器部分引入通道注意力模块。

编码器包含四个下采样块,每个块包含两个的卷积层和一个的最大池化层。每个卷积层后面都有一个BN和一个ELU激活函数。

解码器包含四个上采样块,每个块和下采样块类似,但是池化层被替换为的转置卷积层。

U-Net通过多次下采样获得不同分辨率信息通过跳跃连接传输给解码器的同一级别上采样层。但是U-Net没有遴选不同通道特征,缺乏处理不同地震道信息的灵活性。

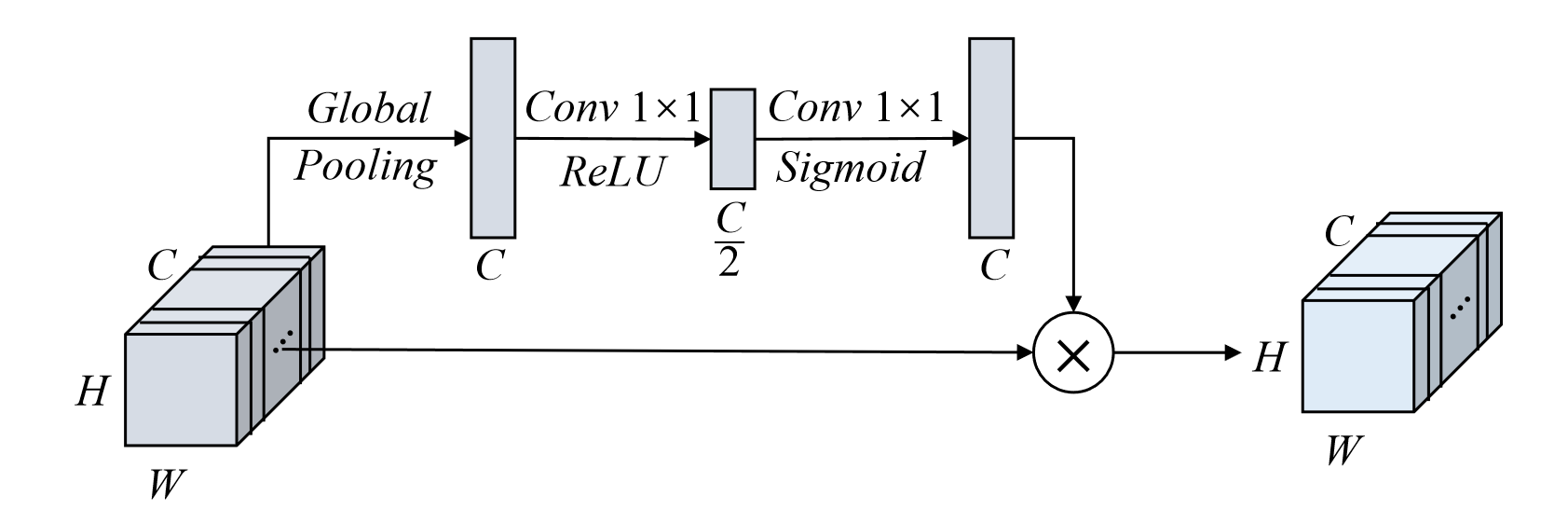

所以作者给编码器加上了通道注意力模块。每个块由一个自适应卷积和两个卷积层构成。同时第一个卷积层后为ReLU激活函数,第二个卷积层后为Sigmoid激活函数。

通道注意力模块可以进一步处理U-Net每一层提取的特征,将重点放在地震数据的关键特征上。由于地震数据规模很大、分布复杂,并且具有高局部相关性和低全局相关性的固有特点。通过通道注意力模块可以使模型更侧重于学习局部特征的相关性。

物理卷积

- 看到这里才发现,这里所谓的物理卷积就是指数学上的卷积运算,只是因为DL中也包含卷积这个东西所以这里用物理卷积进行指代。

训练

输入尺寸:,批次大小,训练轮,学习率为,选用作为损失函数,Adam作为优化器。

训练集包含组数据,数据通过步长为的滑动窗口生成。

结果

在合成和真实数据上表现不错。

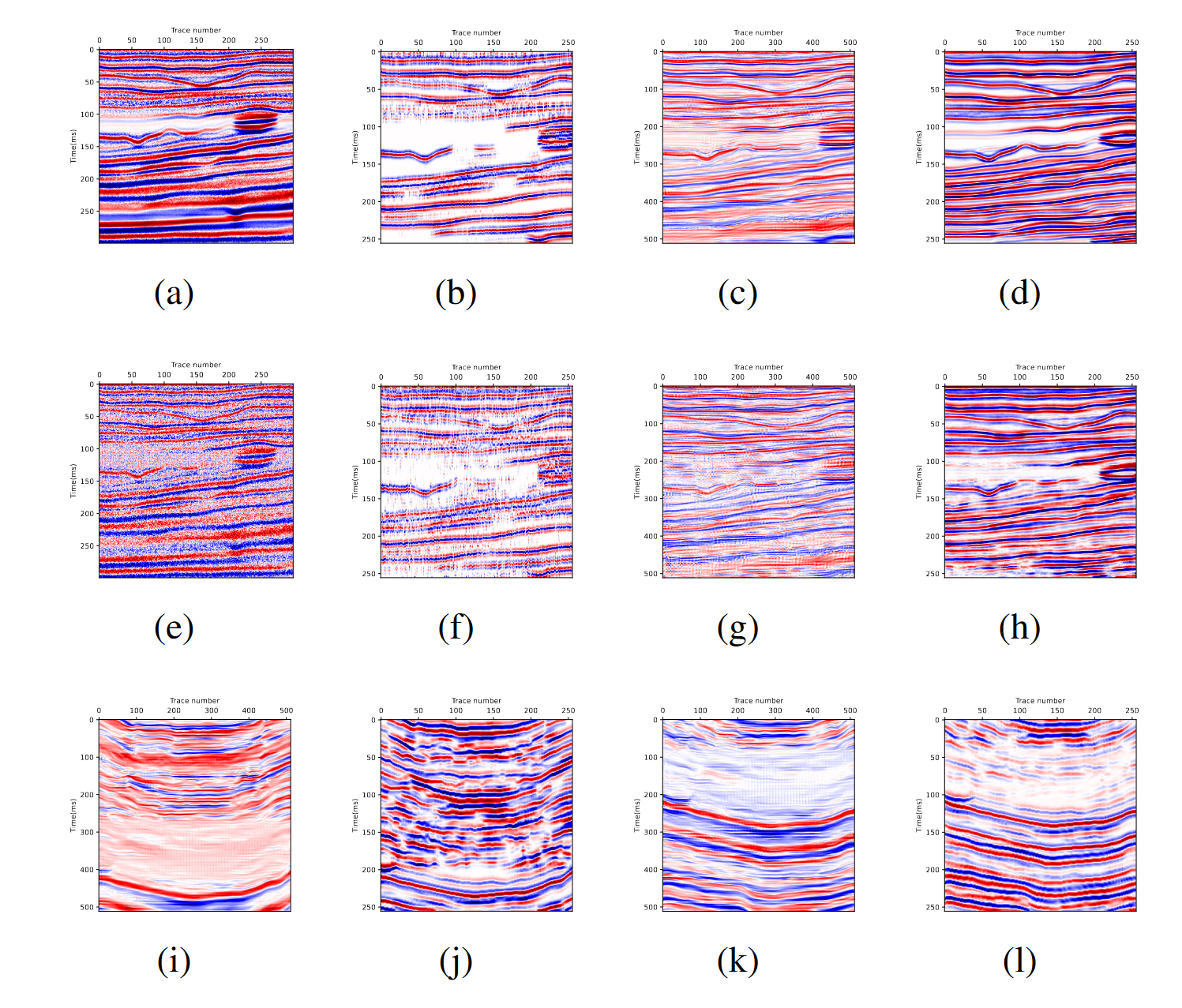

图4. 结果对比。 图4 第一列为真实数据,第二列为FISTA算法(传统算法)增强结果,第三列为CNN增强结果,第四列为CAUC增强结果。

其中第一行为低噪音()数据,第二行为高噪音()数据,第三行为真实数据。

总结

- 一种结合通道注意力和U-Net的反射系数反演算法。